ハルシネーションとは?

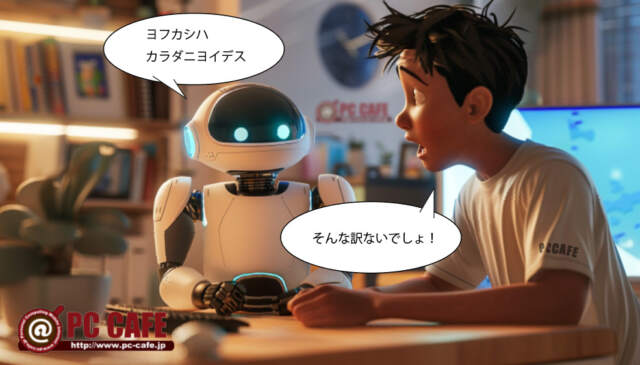

人工知能(AI)、特に大規模言語モデルにおいて、「ハルシネーション(Hallucination)」とは、AIが事実ではない、あるいは誤った情報を、あたかも真実であるかのように生成してしまう現象を指します。英語を直訳すると「幻覚」とか「錯覚」という意味で、まるでAIが幻覚を見ているかのように、もっともらしい嘘や誤情報を自信満々に提示するため、AI関連用語として、このように呼ばれています。

具体例

- 存在しない人物や出来事の捏造: AIが実在しない歴史上の人物について詳細な説明をしたり、実際には起こらなかった出来事について語る。

- 誤った数値や統計データの提示: 正確な情報源に基づかない数値や統計データを提示し、誤解を招く可能性がある。

- 論理的に矛盾した内容の生成: 前提と矛盾する結論を導き出したり、文脈にそぐわない情報を提示する。

ハルシネーションの原因

ハルシネーションの主な原因は、AIの学習データにあります。

- 不十分な学習データ: AIが学習したデータが限られている場合、事実と異なる情報を生成してしまう可能性が高まります。

- 偏った学習データ: 特定の視点や意見に偏ったデータで学習した場合、AIはその偏りを反映した情報を生成してしまうことがあります。

- 学習データのノイズ: 学習データに誤りや矛盾が含まれている場合、AIはその誤りを学習し、誤った情報を生成してしまう可能性があります。

ハルシネーションがもたらすリスク

ハルシネーションは、AIの信頼性を損ない、様々なリスクをもたらします。

- 誤情報の拡散: AIが生成した誤情報が、人々の誤解や混乱を招き、社会に悪影響を与える可能性があります。

- 偏見や差別の助長: AIが偏った情報を生成することで、特定のグループに対する偏見や差別を助長してしまう可能性があります。

- 意思決定の誤り: AIが生成した誤情報に基づいて意思決定を行うと、誤った判断を下してしまう可能性があります。

事実、何も考えずに仕事の量を減らすために生成AIなどを利用している人が、ハルシネーションだらけのレポートを提出したり、資料を作って学校や会社に提出しているケースが増えています。

ハルシネーションへの対策

ハルシネーションを完全に防ぐことは困難ですが、その影響を軽減するための対策がいくつかあります。

- 学習データの改善: より網羅的で、偏りのない、正確なデータでAIを学習させる。

- ファクトチェック機能の導入: AIが生成した情報を自動的にファクトチェックする仕組みを導入する。

- 人間のフィードバック: AIが生成した情報を人間が確認し、フィードバックを与えることで、AIの学習を促進する。

ファクトチェックは他人にわたる情報を取り扱う場合に特に重要で、こういったAIが巻き起こす誤解を未然に防ぐ作業は必要不可欠なものになってきます。

ハルシネーションは、AIが抱える課題の一つですが、その原因と対策を理解することで、AIをより安全かつ効果的に活用することができます。AIの進化とともに、ハルシネーションへの対策も進歩していくことが期待されます。